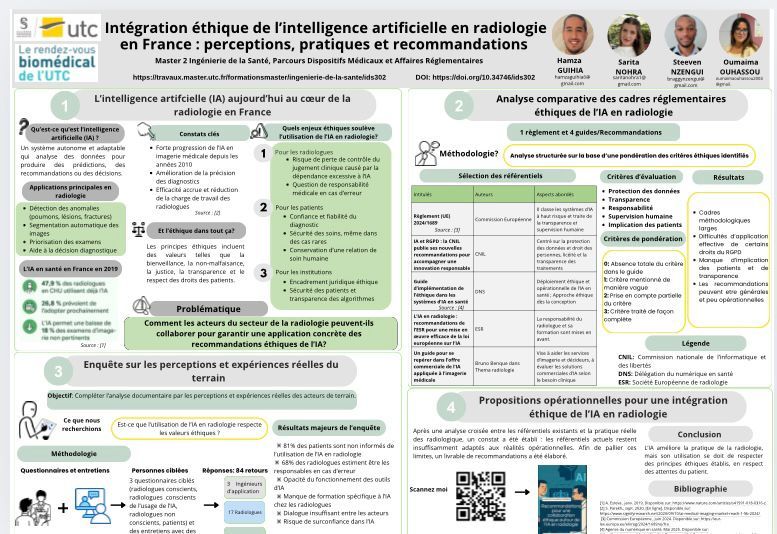

IDS302 - Intégration éthique de l'IA en radiologie en France : perceptions, pratiques et recommandations

DOI mémoire

https://doi.org/10.34746/ids302Catégories

Les projets ou stages publiés auxquels vous accédez sont des rapports d'étudiants et doivent être pris comme tels. Il peuvent donc comporter des imperfections ou des imprécisions que tout lecteur doit admettre et donc supporter. Il ont été réalisés pendant les périodes de formation et constituent avant-tout des travaux de compilation bibliographique, d'initiation et d'analyse sur des thématiques associées aux concepts, méthodes, outils et expériences sur les démarches qualité dans les organisations ou sur les technologies en santé.

Si, malgré nos précautions, vous avez des raisons de contester ce droit de diffusion libre, merci de nous en faire part (master@utc.fr), nous nous efforcerons d'y apporter une réponse rapide. L'objectif de la présentation des travaux sur le web est de permettre l'accès à l'information et d'augmenter ainsi la qualité des échanges professionnels.

Nous ne faisons aucun usage commercial des travaux de projet ou de stage publiés, par conséquent les citations des informations et l'emploi des outils mis à disposition sont totalement libres. Dans ce cas, nous vous demandons de respecter les règles d'éthique en citant explicitement et complètement vos sources bibliographiques.

Bonne lecture...

Auteurs

Contacts

- GUIHIA Hamza : hamzaguihia6@gmail.com

- NOHRA Sarita : saritanohra1@gmail.com

- NZENGUI Steeven : braggynzengui@gmail.com

- OUHASSOU Oumaima : oumaimaouhassou2003@gmail.com

Citation

A rappeler pour tout usage : H.GUIHA, S.NOHRA, S. NZENGUI, O.OUHASSOU, "Intégration éthique de l'IA en radiologie en France : perception, pratiques et recommandations ", Université de Technologie de Compiègne (France), Master Ingénierie de la Santé, Parcours Dispositif médical et affaires réglementaires, Mémoire de Projet, https://travaux.master.utc.fr/, réf n° IDS302, janvier 2026, https://travaux.master.utc.fr/formations-master/ingenierie-de-la-sante/ids302/, https://doi.org/10.34746/ids302

Remerciements

D’emblée, nous souhaitons remercier l’Université de Technologie de Compiègne et l'ensemble des professeurs pour l’accompagnement et la qualité de leur enseignement durant ce semestre. Leur expertise a largement contribué à notre développement personnel et professionnel.

Nous remercions tout particulièrement Madame Julie Follet, encadrante du projet, pour sa disponibilité, son accompagnement et ses précieux conseils tout au long de ce travail. Nous remercions également Madame Isabelle Claude, responsable de l’UE, pour son soutien et l’encadrement pédagogique apporté dans le cadre de cette unité d’enseignement.

Nous adressons également nos remerciements à l’ensemble des experts et professionnels qui ont accepté de partager leur expérience et leur expertise, apportant un éclairage essentiel à la réflexion menée dans le cadre de ce projet.

Nous remercions nos familles et nos amis pour leur soutien constant, ainsi que les membres de notre groupe pour leur collaboration, leur engagement et leur esprit d’équipe tout au long de ce projet.

Enfin, nous souhaitons exprimer notre profonde gratitude à toutes les personnes qui ont, de près ou de loin, contribué à la réalisation de ce projet.

Résumé

L’intelligence artificielle est de plus en plus utilisée en radiologie, notamment pour l’aide au diagnostic. Si elle apporte des bénéfices cliniques significatifs, son intégration soulève toutefois des enjeux éthiques et réglementaires majeurs. Ceux-ci concernent en particulier la transparence des algorithmes et des décisions produites par les systèmes d’IA, la supervision humaine des résultats générés afin de garantir un contrôle médical effectif, la responsabilité en cas d’erreur diagnostique impliquant un système d’IA, la formation des professionnels de santé à l’utilisation, aux limites et aux biais des outils d’IA, ainsi que l’information des patients sur l’usage de l’IA dans leur prise en charge, les finalités du traitement de leurs données et leurs droits associés.

Ce travail repose sur une enquête terrain combinant des questionnaires soumis à des radiologues et des patients afin d’évaluer leur perception, leur niveau de confiance et leur compréhension de l’usage de l’IA en radiologie, ainsi que des entretiens menés avec des ingénieurs d’application dans le but de comprendre les contraintes techniques, organisationnelles et réglementaires des systèmes d’IA, ainsi que les pratiques actuelles d’accompagnement des utilisateurs. Cette approche est complétée par l’analyse des principaux cadres réglementaires et éthiques encadrant l’IA en santé (AI Act, recommandations de la CNIL et lignes directrices de l’OMS).

Les résultats mettent en évidence un écart entre les exigences éthiques et réglementaires formalisées (transparence, supervision humaine, information du patient, responsabilité et gestion des biais) et les pratiques réelles observées sur le terrain, notamment en matière d’information des patients, de traçabilité de l’usage de l’IA et de formation des professionnels. À partir de cette analyse croisée des données issues des questionnaires, des entretiens et des textes réglementaires, des propositions opérationnelles concrètes ont été formulées, telles que la mise en place de protocoles de supervision humaine, le renforcement de la formation des utilisateurs et l’amélioration de l’information des patients, afin de favoriser une intégration éthique et responsable de l’IA en radiologie.

Abstract

Artificial intelligence is increasingly used in radiology, particularly for diagnostic support. While it provides significant clinical benefits, its integration nonetheless raises major ethical and regulatory challenges. These issues notably concern the transparency of algorithms and of the decisions produced by AI systems, human oversight of generated results in order to ensure effective medical control, liability in the event of diagnostic errors involving an AI system, the training of healthcare professionals in the use, limitations, and biases of AI tools, as well as informing patients about the use of AI in their care, the purposes of data processing, and their associated rights.

This work is based on a field study combining questionnaires administered to radiologists and patients in order to assess their perceptions, levels of trust, and understanding of the use of AI in radiology, as well as interviews conducted with application engineers to understand the technical, organizational, and regulatory constraints of AI systems and current user support practices. This approach is complemented by an analysis of the main regulatory and ethical frameworks governing AI in healthcare (the AI Act, CNIL recommendations, and WHO guidelines). The results highlight a gap between formalized ethical and regulatory requirements (transparency, human oversight, patient information, accountability, and bias management) and real-world practices observed in the field, particularly with regard to patient information, traceability of AI use, and professional training. Based on this cross-analysis of data from questionnaires, interviews, and regulatory texts, concrete operational proposals were formulated, such as the implementation of human oversight protocols, strengthening user training, and improving patient information, in order to promote an ethical and responsible integration of AI in radiology.

Téléchargements

Intégration éthique de l'IA en radiologie en France : perceptions, pratiques et recommandations

Introduction

L’intelligence artificielle (IA) constitue aujourd’hui une avancée technologique majeure en santé, et plus particulièrement en radiologie, où elle est principalement utilisée comme outil d’aide au diagnostic, notamment pour la détection d’anomalies, la segmentation d’images ou la priorisation des examens. Depuis le début des années 2010, les progrès en apprentissage automatique ont conduit au développement d’outils dont les performances peuvent se rapprocher de celles des radiologues dans certaines tâches spécifiques [1]. Cette évolution s’accompagne d’une forte croissance économique du secteur : selon l'agence Signify Research, le marché mondial de l’IA en imagerie médicale pourrait atteindre 1,36 milliard de dollars d’ici 2026, avec un taux de croissance annuel moyen supérieur à 26 % [2].

Historiquement, la radiologie a constitué un terrain privilégié pour le développement de l’informatique médicale, en raison du caractère numérique des images et des volumes importants de données à analyser. Les applications d’IA se sont ainsi concentrées sur des tâches telles que la détection d’anomalies, la segmentation et l’aide à la priorisation des examens. Des entreprises comme Incepto Médical, Aidoc ou Zebra Medical Vision développent aujourd’hui des solutions d’aide à la décision intégrées aux systèmes d’information hospitaliers [3].

Toutefois, ces avancées technologiques ne peuvent être dissociées d’une réflexion éthique. Plusieurs travaux soulignent que le progrès technique, à lui seul, ne garantit ni la qualité des soins ni le respect des valeurs humaines, et qu’il doit s’inscrire dans un cadre normatif et responsable [4]. En radiologie, l’intégration de l’IA soulève ainsi des enjeux majeurs concernant la supervision humaine, la responsabilité médicale, la protection des données et la confiance des patients [5].

Dans ce contexte, ce projet vise à analyser les principales applications de l’IA en radiologie, à en identifier les apports et les limites, ainsi qu’à étudier les enjeux éthiques et réglementaires associés. Il s’attache également à formuler des recommandations destinées à favoriser une intégration responsable, justifiable et centrée sur l’humain des outils d’IA en imagerie médicale.

Chapitre 1 - Intelligence artificielle et santé : définitions, réglementation et considérations éthiques

Ce chapitre présente le contexte de l’IA en radiologie, en introduisant d’abord les fondements technologiques de l’IA, en particulier le deep learning, puis son adoption progressive en France, avant d’aborder les enjeux éthiques et réglementaires associés à son utilisation clinique. Il cartographie également les acteurs internes et externes impliqués et analyse les enjeux éthiques et pratiques de l’IA. Cette base théorique permet de formuler la question de recherche qui guidera l’ensemble de l’étude.

1.1. Définition et principes éthiques de l’intelligence artificielle en radiologie

L’essor rapide de l’IA en radiologie, depuis les premiers systèmes d’aide à la détection jusqu’aux réseaux de neurones profonds, montre que le progrès technologique, aussi impressionnant soit-il, ne garantit pas un usage fiable et éthique. Pour exploiter ces outils de manière responsable, il est essentiel de définir clairement ce que l’on entend par IA et par éthique, et de comprendre les principes encadrant leur utilisation.

1.1.1 Intelligence artificielle

L’article 3 du Règlement (UE) 2024/1689 (ou AI Act pour Artificial Intelligence Act) définit un système d’IA comme « un système fondé sur une machine, conçu pour fonctionner avec différents degrés d’autonomie et pouvant faire preuve d’adaptabilité après son déploiement. Pour des objectifs explicites ou implicites, il détermine, à partir des données qu’il reçoit, la manière de produire des résultats tels que des prédictions, du contenu, des recommandations ou des décisions susceptibles d’influencer des environnements physiques ou virtuels" [5].

De cette définition se dégagent trois caractéristiques essentielles propres aux systèmes d’IA :

- Un certain degré d’autonomie, signifiant qu’ils ne sont pas entièrement contrôlés par l’humain à tout moment.

- Une capacité d’apprentissage automatique et d’auto-ajustement fondée sur l’analyse des données, permettant l’actualisation des modèles et des performances du système après sa mise en service.

- Une action sur l’environnement, par la production de résultats susceptibles d’influencer le monde réel ou virtuel.

D’un point de vue scientifique, l’IA est définie comme « la science et l’ingénierie de la création de machines intelligentes, fondées sur des algorithmes ou des règles, imitant les fonctions cognitives humaines telles que l’apprentissage et la résolution de problèmes » [6].

À la lumière de ces approches, une définition adaptée au contexte de l’imagerie médicale peut être proposée :

L’IA désigne une entité logicielle et matérielle fonctionnant avec un certain degré d’autonomie, capable de s’adapter à partir des données reçues et de générer des résultats, prédictions, recommandations, décisions ou contenus ayant un impact sur des environnements physiques ou virtuels. Concrètement, en imagerie médicale, l’IA exploite des données d’imagerie et des informations cliniques pour assister le radiologue dans diverses tâches. Elle peut ainsi automatiser la segmentation des structures anatomiques, détecter des anomalies, classer les lésions et apporter une aide au diagnostic, contribuant à améliorer la précision et l’efficacité des examens. Cette définition combine les critères juridiques issus du règlement européen (autonomie et adaptabilité) et les dimensions cognitives et fonctionnelles mises en avant par la littérature scientifique récente.

1.1.2 Réseaux de neurones en radiologie

Après avoir défini l’IA ainsi que ses capacités d’apprentissage, d’adaptation et d’analyse, il est important de comprendre sa structure interne et les techniques qui la composent. L’IA n’est pas seulement une entité unique, mais un ensemble de méthodes et d’architectures permettant aux machines de traiter des données, d’apprendre et de produire des résultats exploitables. Dans ce cadre, le machine learning et le deep learning occupent une place centrale [7].

L’imagerie médicale s’appuie très largement sur ces techniques. Le machine learning, sous-catégorie de l’IA, permet à un système d’apprendre à partir de données plutôt que d’être programmé explicitement pour chaque tâche. Cette approche a ensuite été complétée par le deep learning, qui repose sur des réseaux de neurones artificiels. Ces derniers sont composés de neurones interconnectés organisés en couches : une couche d’entrée, plusieurs couches cachées et une couche de sortie. Chaque neurone reçoit des signaux provenant des neurones de la couche précédente, pondérés par des coefficients appelés poids, qui déterminent l’importance de chaque information. Ces signaux sont ensuite transformés via une fonction d’activation et transmis aux neurones suivants. L’apprentissage consiste à ajuster ces poids progressivement grâce à la rétropropagation (backpropagation), minimisant l’erreur entre les prédictions du réseau et les résultats attendus [8].

Ces algorithmes sont capables d’extraire et de hiérarchiser automatiquement les caractéristiques les plus pertinentes dans des masses de données complexes, typiquement des images médicales.

Dans le domaine de la radiologie, cette capacité a permis d’automatiser de nombreuses étapes de l’analyse d’images. Par exemple, les réseaux de neurones convolutifs (CNN) sont largement utilisés pour la détection d’anomalies, la segmentation des tissus ou la classification des lésions, avec une fiabilité souvent comparable à celle des experts humains. Ces systèmes ne remplacent pas les radiologues, mais renforcent leur capacité d’interprétation, en aidant à prioriser les cas complexes et à identifier des signes discrets de pathologie. Selon Signify Research, près de 70 % des systèmes d’IA en diagnostic par imagerie reposent sur le deep learning [2].

1.2. Adoption de l'intelligence artificielle en radiologie en France

En 2024, dans les centres hospitalo-universitaires français, près de la moitié des radiologues interrogés (47,9 %) (soit 8 radiologues sur 17) ont déclaré utiliser déjà des outils d'IA dans leur pratique clinique, tandis qu’environ un quart d’entre eux (26,8 %) envisagent de le faire prochainement. Dans certains groupements hospitaliers, l’utilisation de ces outils d’aide à la décision permet de réduire de 18 % les examens d’imagerie jugés non pertinents. Bien que la France ne soit pas nécessairement leader mondial dans ce domaine, elle figure parmi les acteurs dynamiques de l’innovation en IA appliquée à la radiologie [9,10].

L’ensemble de ces usages est encadré sur le plan réglementaire, à la fois au niveau européen et national. Selon l'AI Act, les dispositifs basés sur l’IA, considérés comme des dispositifs médicaux à « haut risque », sont soumis à des obligations strictes en matière de transparence, de supervision humaine et de documentation des biais. Par ailleurs, l’arrivée de l’Espace Européen des Données de Santé en mars 2025 régulera la réutilisation des données de santé pour la recherche et l’innovation, dans un cadre sécurisé et éthique [11,12].

Ainsi, en France, l’IA en radiologie n’est plus seulement un outil expérimental : elle est de plus en plus intégrée à la pratique clinique, contribuant à une meilleure efficacité diagnostique et à un usage plus rationnel des ressources hospitalières, tout en restant encadrée par des réglementations strictes pour garantir sa sécurité et son éthique d’utilisation.

1.3. Éthique et bonnes pratiques de l’intelligence artificielle en radiologie

Dans le cadre de ce projet, nous nous fondons sur l’éthique de la responsabilité de Hans Jonas (1979) selon laquelle toute innovation technologique ne peut être envisagée qu’au regard de ses conséquences pour l'humanité [13]. Elle se conçoit dans le cadre des principes de bioéthique définis par Beauchamp et Childress (2013) : bienfaisance, non-malfaisance, autonomie et justice [14]. En l’occurrence, pour l’IA en radiologie, il s’agit de construire et d’utiliser les algorithmes de deep learning de manière transparente, sous contrôle et en responsabilité. En d’autres termes, l’usage de l’IA doit contribuer à l’amélioration de la qualité du diagnostic et de la santé du patient, ne pas exposer les personnes à des risques non maîtrisés, ne pas se produire en dehors du consentement du patient. En particulier, pour la radiologie, cela signifie que l’algorithme est fiable, explicable et équitable, et que le respect des droits fondamentaux des patients est garanti comme le recommande l’Organisation mondiale de la santé (OMS) [15].

Le concept de l’IA de confiance (Trustworthy AI) constitue pour la santé la norme éthique internationale, au nom de la robustesse technique, de la transparence algorithmique et de la responsabilité humaine. La pertinence des systèmes IA en radiologie dépend de la performance mais aussi de l’explicabilité, du contrôle des biais et du feedback des utilisateurs sur l’appropriation des résultats [16]. Les FUTURE-AI Guidelines préconisent l’audit des jeux de données, la validation multicentrique des résultats, la traçabilité des décisions et la documentation des modèles de deep learning dans l’objectif de garantir la transparence et la sécurité clinique [17].

En juillet 2025, la Délégation au Numérique en Santé (DNS) française a élaboré un guide d’implémentation de l’éthique dans les systèmes d’intelligence artificielle (SIA) en santé, qui précise que la réflexion éthique doit être intégrée dès la conception et l’évaluation des systèmes numériques, avec des dispositifs d’audit, de contrôle et de suivi tout au long du cycle de vie des solutions [18]. Ce guide vise à accompagner les acteurs de la santé dans le déploiement responsable des solutions d’IA, en mettant l’accent sur des principes tels que la transparence, la responsabilité, la supervision humaine et la protection des données personnelles.

En complément de cette dimension éthique, le cadre juridique applicable aux systèmes d’IA en santé s’appuie sur l'AI Act et sur le Règlement Général sur la Protection des Données (RGPD), qui imposent des exigences strictes de sécurité, de transparence, d’explicabilité et de protection des données personnelles. Ces règles garantissent que les systèmes d’IA utilisés dans le domaine médical respectent les droits des patients et demeurent conformes aux normes légales tout au long de leur cycle de vie.

Le guide d’implémentation de l'éthique dans les SIA en santé proposé par la DNS identifie cinq grands principes fondamentaux : responsabilité, transparence, explicabilité, équité et proportionnalité. Ces principes constituent le fil conducteur de notre réflexion sur l’utilisation du deep learning à visée radiologique, afin de garantir l’explicabilité, la fiabilité et la conformité réglementaire de l’IA au service des patients [18].

C’est ainsi que nous définissons pour ce projet l’éthique comme l’ensemble des principes et pratiques assurant que le numérique en santé, et plus particulièrement le deep learning en radiologie, est au service de l’humain, respectueux et gardien de la valeur fondamentale de la dignité humaine sous la responsabilité des humains (transparence et explicabilité des modèles, responsabilité des concepteurs et utilisateurs, équité et absence de biais dans les jeux de données, bienfaisance et non-malfaisance du patient, proportionnalité entre moyens techniques et bénéfice espéré, respect de la vie privée).

1.4. Cartographie des acteurs impliqués dans l'intelligence artificielle utilisée en radiologie

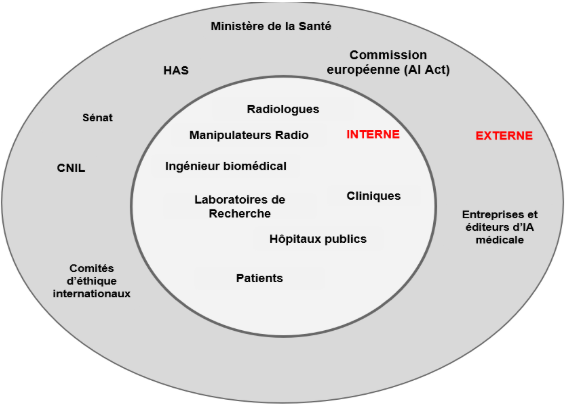

L’intégration de l’IA en radiologie mobilise une diversité d’acteurs, chacun jouant un rôle essentiel dans la conception, la régulation et l’utilisation éthique de ces technologies. La cartographie ci-dessous illustre les différents acteurs impliqués :

Figure 1 : Cartographie des acteurs dans l'intégration de l'intelligence artificielle en radiologie en France [source : auteurs]

Dans le cadre de l’utilisation de l’IA en santé, plusieurs acteurs internes jouent un rôle essentiel. Les radiologues sont des médecins spécialisés dans l’interprétation des images médicales, tandis que les manipulateurs radio réalisent les examens d’imagerie. L’ingénieur biomédical est chargé de gérer les équipements médicaux et d’assurer leur bon fonctionnement, y compris les solutions d’IA. Les laboratoires de recherche développent et testent de nouvelles technologies en imagerie et en IA. Enfin, les hôpitaux publics constituent les structures de soins qui déploient l’IA afin d’améliorer la qualité des diagnostics et des prises en charge.

Parallèlement, de nombreux acteurs externes interviennent dans le développement, l’encadrement et la régulation des technologies d’IA médicale. Les entreprises et éditeurs spécialisés conçoivent et commercialisent les algorithmes utilisés dans ces solutions, tandis que la Haute Autorité de Santé (HAS) évalue les technologies médicales et émet des recommandations pour leur usage optimal. La Commission européenne, à travers l’AI Act, établit le cadre réglementaire européen pour l’IA, notamment en santé, et le Parlement participe à l’élaboration des lois encadrant son usage en France. La Commission Nationale de l'Informatique et des Libertés (CNIL) veille à la protection des données personnelles, particulièrement dans le contexte des outils d’IA médicale. Les comités d’éthique internationaux réfléchissent aux implications morales et éthiques liées à l’usage de l’IA en médecine et des logiciels médicaux. Enfin, le Ministère de la Santé définit les grandes orientations nationales en matière de santé et de technologies.

1.5. L’IA en radiologie : enjeux et considérations éthiques

L’IA en radiologie apporte de nombreux avantages, mais elle soulève aussi plusieurs enjeux éthiques importants pour les différents acteurs du domaine. Pour les radiologues et autres professionnels de santé impliqués dans l’interprétation des examens, le principal risque est la perte de contrôle du jugement clinique : en s’appuyant trop sur les outils d’IA, ils peuvent devenir dépendants des résultats proposés par la machine. Cela pose aussi la question de la responsabilité médicale en cas d’erreur de diagnostic. Les radiologues doivent donc garder leur autonomie professionnelle, être correctement formés et capables d’utiliser l’IA comme un outil d’aide, et non comme un remplaçant [19].

Au CHU de Poitiers, un radiologue indique qu’environ 75 % des radiographies réalisées aux urgences ne font plus l’objet d’une relecture systématique par un autre radiologue. Les images sont néanmoins analysées directement par les radiologues en charge, parfois avec l’aide d’outils d’IA pour orienter le diagnostic ou détecter des anomalies. Cependant, la décision finale doit toujours revenir au radiologue afin de garantir la sécurité du patient et d’éviter les erreurs liées à une confiance excessive dans l’algorithme [19].

Du point de vue du patient, plusieurs aspects éthiques sont à considérer. Tout d’abord, la confiance et la fiabilité du diagnostic sont essentielles : le patient souhaite que les résultats fournis par l’IA et le radiologue soient corrects et conduisent à un traitement efficace. La sécurité des soins constitue également un enjeu majeur, car le patient doit être assuré que l’IA ne commettra pas d’erreurs, même dans des cas rares. Par ailleurs, il est important de maintenir l’humanité de la relation de soins, car le patient peut craindre d’être remplacé par une machine. Enfin, la question de la justice et de l’égalité d’accès se pose : tous les patients, qu’ils vivent en ville ou à la campagne, qu’ils soient riches ou pauvres, devraient bénéficier du même niveau de diagnostic.

Les institutions publiques, telles que la HAS ou le Ministère de la Santé, ont pour mission d’assurer un cadre juridique et éthique pour le développement de l’IA en santé. Elles veillent à la sécurité des patients, à la transparence des algorithmes et à la protection des données de santé, afin d’éviter que les IA utilisées dans les hôpitaux soient entraînées uniquement sur des bases étrangères.

Les éditeurs d’IA, tels que Incepto, Siemens ou GE Healthcare, ont également une grande responsabilité. Ils doivent assurer une transparence sur le fonctionnement de leurs algorithmes, garantir une validation clinique rigoureuse et vérifier les performances réelles de leurs outils, afin de ne pas privilégier les intérêts économiques au détriment de la sécurité des patients. La collaboration entre ces entreprises et les professionnels de santé doit être concrète, basée sur la confiance et la responsabilité partagée.

1.6. Question de recherche

L’IA transforme la radiologie en améliorant la rapidité et la précision des diagnostics, mais soulève des enjeux éthiques majeurs : protection des données, transparence des algorithmes, responsabilité médicale et équité d’accès aux technologies d’IA et aux soins qu’elles soutiennent. Il est donc essentiel que radiologues, patients, entreprises et régulateurs collaborent pour garantir un usage sûr et éthique de l’IA. Cette réflexion conduit naturellement à la question suivante :

Comment les acteurs du secteur de la radiologie peuvent-ils collaborer pour garantir une application concrète des recommandations éthiques de l’IA ?

Chapitre 2 - Analyse des référentiels éthiques et étude de terrain

Le présent chapitre vise à analyser les guides existants relatifs à l’intégration éthique et pratique de l’IA en radiologie, ainsi qu’à confronter leurs principes aux pratiques réelles observées sur le terrain. Il présente la sélection des guides étudiés, leur évaluation méthodique, la synthèse des failles identifiées et la méthodologie mise en œuvre pour l’élaboration des livrables du projet.

Pour atteindre ces objectifs, une méthodologie mixte a été adoptée. Elle repose, d’une part, sur une analyse documentaire et réglementaire des cadres applicables à l’IA en radiologie, incluant les exigences juridiques européennes et leur déclinaison nationale, ainsi que les recommandations institutionnelles et professionnelles. D’autre part, elle s’appuie sur une enquête de terrain, permettant d’évaluer l’intégration concrète de l’IA dans la pratique clinique.

Cette démarche permet d’analyser :

- Les écarts éventuels entre cadres normatifs, recommandations et usages.

- La manière dont les principes éthiques sont formalisés dans les guides étudiés.

- Leur mise en œuvre effective dans les pratiques professionnelles.

2.1. Analyse des référentiels sélectionnés

2.1.1 Rationnel de sélection des référentiels

Pour répondre à la problématique de l’intégration éthique et opérationnelle de l’IA en radiologie, plusieurs guides et référentiels ont été élaborés afin d’accompagner les professionnels dans l’adoption de ces technologies. Il apparaît toutefois nécessaire d’en évaluer l’efficacité réelle, d’analyser la couverture des enjeux éthiques, techniques et organisationnels, et d’identifier leurs éventuelles lacunes.

Dans le cadre de cette étude, un premier document, le "guide pour bien se repérer dans l’offre commerciale d’IA appliquée à l’imagerie médicale" a été retenu [20]. Fondé sur les travaux des ECLAIR guidelines, ce guide s’adresse aux professionnels de la radiologie impliqués dans l’évaluation et le choix des solutions d’IA. Sa pertinence repose sur son approche pratique, intégrant des dimensions techniques, organisationnelles et réglementaires, ainsi que sur son adéquation avec les évolutions récentes du cadre européen, notamment le Règlement européen relatif aux dispositifs médicaux.

Afin de compléter cette analyse opérationnelle, un second guide, à portée européenne, a été étudié : « Guiding AI in Radiology : ESR’s Recommendations for Effective Implementation of the European AI Act », publié en 2025 par la Société Européenne de Radiologie (SER) [21]. Ce document propose des recommandations visant à encadrer l’intégration de l’IA dans la pratique radiologique à l’échelle européenne.

Enfin, l’analyse de ces guides spécifiques à la radiologie a été mise en perspective avec plusieurs référentiels transversaux, à savoir l'AI Act [5], les recommandations de la CNIL relatives au respect du RGPD [22], ainsi que les travaux de l’OMS sur l’éthique et la gouvernance de l’IA en santé [15]. Dans la continuité de cette approche, le guide d’implémentation de l’éthique dans les SIA en santé [18], élaboré par la DNS en collaboration avec l’Agence du Numérique en Santé (ANS), et évoqué au Chapitre 1, est intégré à l'analyse. Cette approche comparative permet d’identifier les convergences et les limites des différents référentiels, et de dégager des pistes d’amélioration pour une intégration éthique et opérationnelle de l’IA en radiologie.

2.1.2 Critères d'évaluation des référentiels retenus

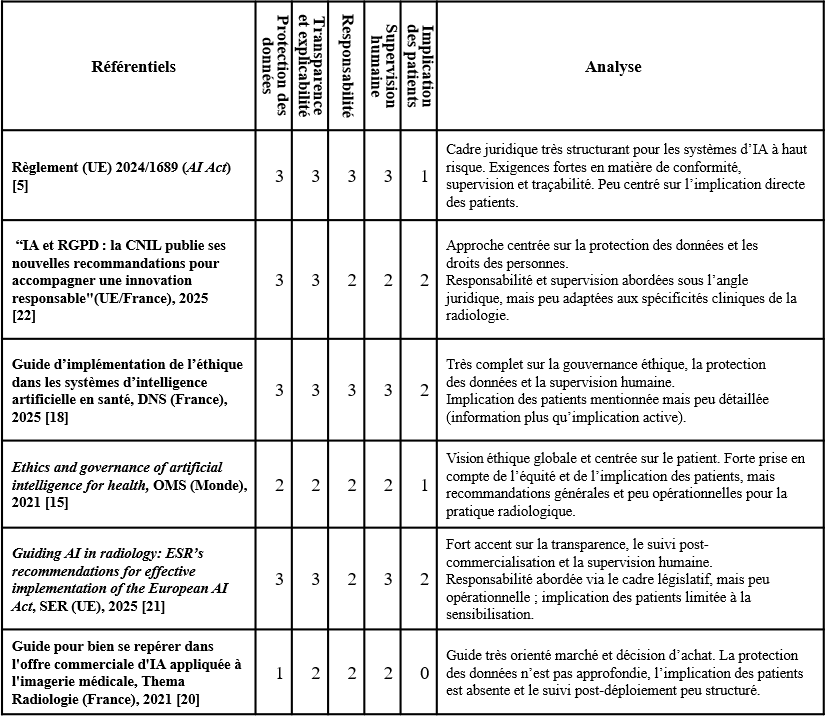

Pour évaluer de manière systématique les guides sélectionnés, nous avons élaboré une grille d’analyse basée sur les principaux enjeux éthiques identifiés dans le domaine de l’IA en radiologie. Cette grille est présentée sous forme de tableau synthétique, chaque ligne correspondant à un guide ou référentiel analysé, et chaque colonne à un critère d'évaluation (cf. Tableau 1).

Tableau 1 : Grille d'analyse des référentiels sélectionnés concernant l'éthique de l'utilisation de l'intelligence artificielle en radiologie

Les critères d'évaluation retenus reflètent les dimensions essentielles permettant une utilisation responsable et sécurisée de l’IA : la protection des données, la transparence et explicabilité des algorithmes, la responsabilité médicale, l’équité d’accès aux solutions d’IA, le suivi post-déploiement, ainsi que l’implication des patients dans le processus décisionnel.

Pour qualifier le niveau de précision et d’opérationnalité des recommandations proposées dans les référentiels sélectionnés, est appliqué à chaque critère d'évaluation un poids, ou note, s'échelonnant de 0 à 3 :

- La note 0 correspond à une situation où aucun élément du référentiel ne permet d'évaluer le critère.

- La note 1 est attribuée lorsque le critère est appréciable de manière très générale, sans appui sur des recommandations concrètes.

- La note 2 est attribuée lorsque des recommandations générales ou des principes directeurs propres au critère d'évaluation sont présents, mais sans modalités précises de mise en œuvre, ni outils permettant une application directe en pratique.

- La note 3 est attribuée lorsque le critère est traité de manière complète et opérationnelle, avec des éléments concrets tels que des procédures, des étapes clairement définies, des rôles identifiés, des mécanismes de suivi ou des recommandations directement applicables dans la pratique professionnelle.

Bien que les documents analysés relèvent de natures différentes, allant du texte de loi aux recommandations institutionnelles ainsi qu'aux guides professionnels, leur analyse croisée est pertinente dans la mesure où ils participent tous à l’encadrement de l’IA en radiologie. L'AI Act fixe les exigences juridiques de référence, tandis que les recommandations institutionnelles et les guides professionnels visent à en faciliter l’appropriation et la mise en œuvre concrète par les acteurs de terrain.

Cette approche multi-niveaux permet d’évaluer la cohérence globale du cadre éthique et réglementaire, d’identifier les écarts entre exigences formelles et pratiques professionnelles, et de mettre en évidence les domaines insuffisamment couverts par les guides existants.

2.1.3 Résultats de l'analyse croisée des référentiels éthiques retenus

La base documentaire de ce travail repose prioritairement sur le cadre réglementaire européen applicable à l’IA en santé, en particulier l'AI Act, qui constitue le socle juridique de référence pour les systèmes d’IA à haut risque, catégorie à laquelle appartiennent les applications utilisées en radiologie [5]. Ce règlement fixe les exigences fondamentales en matière de gouvernance, de sécurité, de transparence, de supervision humaine et de responsabilité.

Ce cadre législatif est complété par des recommandations institutionnelles internationales (OMS) et nationales (CNIL, DNS, ANS). Bien que ces documents n’aient pas de valeur contraignante équivalente à celle de la loi, ils jouent un rôle essentiel dans l’interprétation et l’opérationnalisation des exigences réglementaires, en proposant des principes éthiques et des orientations adaptées aux contextes cliniques [23, 24].

L’analyse intègre également certains travaux portant sur les modèles d’IA de grande taille, en particulier les modèles multimodaux, non pas comme un objet d’étude autonome, mais comme des cas illustratifs des limites actuelles des principes de transparence, d’explicabilité et de gouvernance des systèmes d’IA complexes [25]. Ces enjeux sont directement pertinents pour la radiologie, où les solutions d’IA combinent de plus en plus des données d’imagerie, des informations cliniques et des interfaces textuelles, soulevant des problématiques similaires à celles identifiées pour ces modèles avancés.

L’analyse comparative des référentiels relatifs à l’intégration de l’IA en radiologie met en évidence des écarts significatifs dans la manière dont les principes éthiques fondamentaux sont pris en compte et traduits en pratiques opérationnelles.

Le guide de la DNS [18] se distingue par une couverture étendue des dimensions éthiques et organisationnelles. Il aborde de manière structurée la protection des données, la transparence, la responsabilité, la supervision humaine ainsi que le suivi post-déploiement des systèmes d’IA. Toutefois, l’implication des patients demeure limitée et repose principalement sur une logique d’information descendante, sans mécanismes clairement définis de participation active dans la conception ou l’évaluation des outils d’IA [5].

Le guide de la Société Européenne de Radiologie [21] présente également un haut niveau d’exigence, notamment en matière de transparence, de supervision humaine et de suivi post-marché, en cohérence avec les orientations de l’AI Act [5]. Néanmoins, la responsabilité y est principalement abordée sous un angle juridique général, sans déclinaison opérationnelle précise pour les professionnels de terrain. Par ailleurs, la prise en compte du patient reste limitée à des actions de sensibilisation, sans dispositifs structurés de retour d’expérience.

Le guide de Thema Radiologie [20], bien qu'accessible et utile pour aider les professionnels à se repérer dans l’offre commerciale d’IA en imagerie médicale, présente des limites importantes sur le plan éthique. Les aspects relatifs à la protection des données, à la responsabilité et au suivi post-déploiement y sont traités de manière superficielle, tandis que l’implication des patients est absente. Ce guide constitue davantage un outil d’aide à la décision commerciale qu’un référentiel permettant d’évaluer la conformité éthique ou la fiabilité clinique des solutions proposées.

L’analyse croisée des référentiels sectoriels avec les cadres réglementaires et institutionnels met en lumière plusieurs limites transversales. Les recommandations de la CNIL soulignent notamment les difficultés d’application effective de certains droits du RGPD, tels que l’accès, la rectification ou l’effacement des données, dans le cas de modèles d’IA dits "mémorisants", pour lesquels les données d’entraînement ne sont pas toujours aisément isolables [22]. Tandis que l’AI Act formule des exigences générales applicables aux systèmes d’IA à haut risque afin de couvrir une grande diversité de cas d’usage, ce qui peut rendre leur mise en œuvre opérationnelle progressive et parfois complexe dans les contextes cliniques réels [5].

La transparence, bien que centrale dans l’ensemble des référentiels analysés, constitue également un point de fragilité. Les recommandations de la CNIL indiquent que l’information délivrée aux personnes concernées peut rester relativement générique lorsque les traitements reposent sur des modèles complexes difficiles à expliquer de manière accessible [22]. De même, l’OMS met en évidence la difficulté d’expliquer des systèmes d’IA avancés, notamment les modèles multimodaux, à des publics non experts, malgré les exigences de transparence affichées [25].

Enfin, les enjeux liés aux biais algorithmiques, à la représentativité des données et à la robustesse des modèles sont largement reconnus par les différents référentiels analysés. Les guides institutionnels insistent sur la nécessité de disposer de données de qualité et de mécanismes d’évaluation des performances [5, 15, 18, 22, 25]. Toutefois, ces principes restent souvent formulés à un niveau général et ne sont pas systématiquement déclinés en exigences opérationnelles adaptées aux contextes cliniques spécifiques, selon les modalités d’imagerie, les populations de patients ou les conditions d’acquisition des images.

Dans l’ensemble, cette analyse met en évidence que, malgré leurs apports respectifs, les guides et cadres existants présentent encore des failles importantes en matière d’opérationnalisation des principes éthiques, d’implication des patients et de suivi réel après le déploiement des systèmes d’IA. Ces limites justifient la nécessité de dépasser une approche exclusivement documentaire pour s’appuyer sur une démarche empirique de terrain, permettant de confronter les référentiels théoriques aux réalités professionnelles et d’élaborer des recommandations éthiques plus ancrées, opérationnelles et adaptées au contexte clinique de la radiologie.

2.2. Étude de terrain

2.2.1 Objectifs de l’étude

L’analyse des guides institutionnels et professionnels relatifs à l’intégration éthique de l’IA en radiologie, fondée sur le cadre réglementaire européen et les recommandations nationales et internationales, a permis d’identifier les principaux principes encadrant l’usage de l’IA. Toutefois, cette approche demeure essentiellement normative et ne permet pas, à elle seule, d’évaluer leur application réelle dans la pratique clinique.

Afin de compléter cette analyse documentaire et de répondre aux remarques formulées, il est apparu nécessaire de conduire une enquête de terrain, visant à confronter les exigences réglementaires et éthiques aux usages effectifs et aux perceptions des acteurs concernés. La section suivante présente ainsi la méthodologie de l’étude terrain mise en œuvre, reposant sur des questionnaires et des entretiens semi-directifs.

2.2.2 Méthodologie de l’étude

Afin d’atteindre ces objectifs, une approche méthodologique mixte a été adoptée, combinant des outils quantitatifs et qualitatifs. Cette approche permet de croiser les données issues de différents profils d’acteurs et d’enrichir l’analyse.

L’étude repose sur deux dispositifs complémentaires :

- Des questionnaires destinés à recueillir des données auprès des radiologues d'une part, et des patients d'autre part.

- Des entretiens semi-directifs, menés auprès d’ingénieurs biomédicaux et d’ingénieurs d’application impliqués dans l’intégration des solutions d’IA en radiologie.

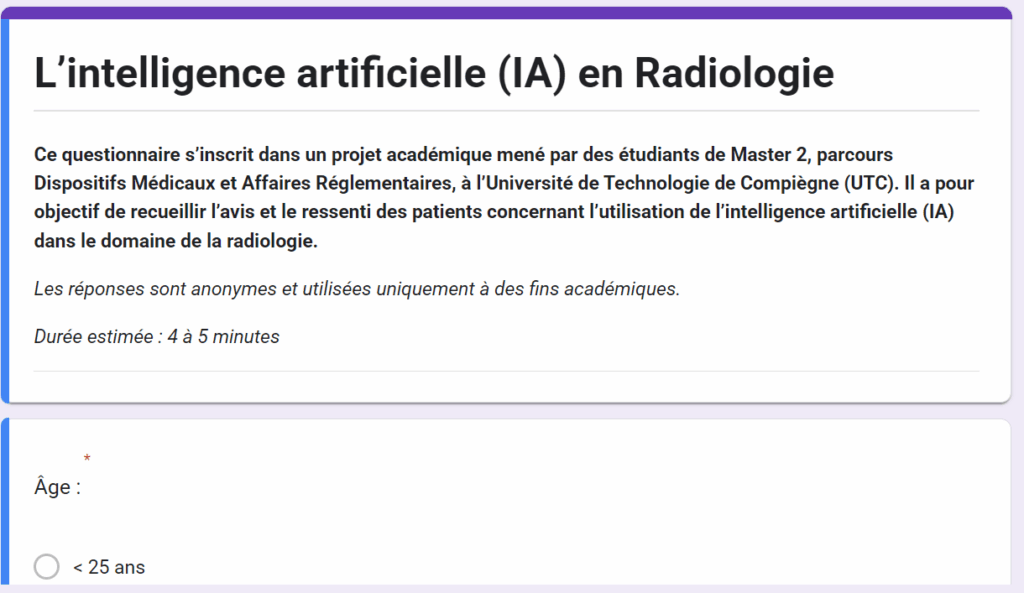

2.2.3 Questionnaires d’analyse des pratiques des radiologues et du ressenti des patients

Deux questionnaires ont été spécifiquement conçus afin d’évaluer la maturité éthique de l’intégration de l’IA en radiologie, en cohérence avec les principes identifiés lors de l’analyse des guides existants.

Le premier questionnaire s’adresse aux radiologues et vise à analyser leurs usages réels de l’IA, leur compréhension du fonctionnement des outils, leur perception des risques et des biais, ainsi que leur niveau de supervision humaine. Il permettait également d’explorer leur perception de la responsabilité associée aux décisions assistées par IA et leurs attentes en matière d’explicabilité, de certification et de formation. Ces dimensions renvoient directement aux grands principes éthiques identifiés dans la littérature et les référentiels existants, notamment la transparence, le contrôle humain, la fiabilité, la non-malfaisance et la responsabilité.

Le second questionnaire est destiné aux patients, dans une démarche complémentaire visant à intégrer la perspective des personnes directement concernées par l’usage clinique de ces technologies. Il portait sur leur niveau d’information concernant l’IA, leur confiance envers les dispositifs automatisés, leur perception du respect de leurs droits (consentement, protection des données, transparence) ainsi que l’impact potentiel de l’IA sur la relation de soins. Ces éléments s’inscrivent dans les principes fondamentaux de l’éthique biomédicale, en particulier l’autonomie, la protection des données personnelles, la bienfaisance et l’équité.

Au total, 80 réponses ont été recueillies pour les deux questionnaires, constituant ainsi une base de données suffisamment représentative pour analyser les perceptions et préoccupations éthiques du terrain. Les questionnaires étaient structurés en sections correspondant aux principaux principes éthiques encadrant l’IA en santé, ce qui facilite leur interprétation en lien avec les cadres normatifs en vigueur et permet une lecture cohérente des enjeux soulevés par les différents acteurs.

2.2.4 Entretiens semi-directifs

Bien que les questionnaires permettent de recueillir des données sur les usages, les perceptions et les attentes des acteurs interrogés, ils présentent certaines limites. En particulier, ce format ne permet pas d’explorer en profondeur les logiques sous-jacentes aux réponses, ni de comprendre finement les contraintes organisationnelles, techniques et réglementaires rencontrées lors de l’intégration concrète des outils d’IA.

Les questionnaires ne permettent pas non plus de saisir la complexité des arbitrages réalisés par les professionnels dans leur pratique quotidienne, notamment en matière de supervision humaine, de gestion des responsabilités ou de suivi post-déploiement des solutions d’IA. C’est pourquoi des entretiens semi-directifs ont été menés afin d’approfondir ces dimensions, en donnant aux participants la possibilité de contextualiser leurs réponses, d’illustrer leurs pratiques par des exemples concrets et d’exprimer des difficultés ou des besoins qui ne peuvent émerger à travers des questions fermées.

Ces entretiens ont permis d’aborder plusieurs dimensions essentielles :

- la manière dont les entreprises conçoivent et intègrent les principes éthiques dans leurs outils ;

- la perception par ces entreprises des préoccupations exprimées par les radiologues, notamment en matière de transparence, de supervision, de biais et de responsabilité ;

- la prise en compte actuelle des exigences réglementaires, en particulier celles de l'AI Act et des recommandations nationales ;

- les pistes de solutions envisageables pour renforcer l’usage responsable de l’IA.

Les informations recueillies en entretien ont également permis de confronter les données issues des questionnaires (radiologues et patients), notamment en matière d'attente des usagers, avec la réalité industrielle afin d’évaluer dans quelle mesure les fabricants peuvent y répondre, que ce soit en termes d’explicabilité, d’indicateurs de confiance, de traçabilité des décisions IA, de protocoles de supervision humaine ou encore de formation des utilisateurs. Ainsi, ces entretiens contribuent à apprécier la faisabilité éthique des recommandations, en mettant en regard les besoins exprimés sur le terrain et les contraintes techniques, organisationnelles et réglementaires propres aux industriels du secteur.

2.2.5 Analyse des réponses fournies par les radiologues

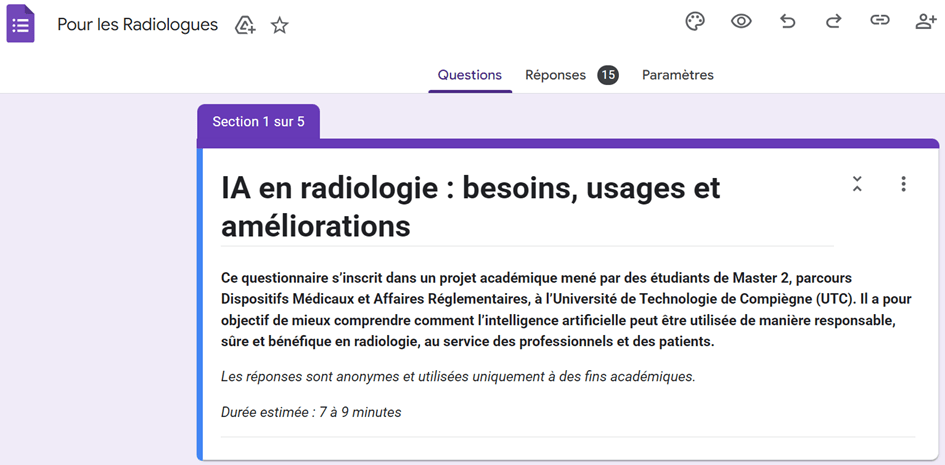

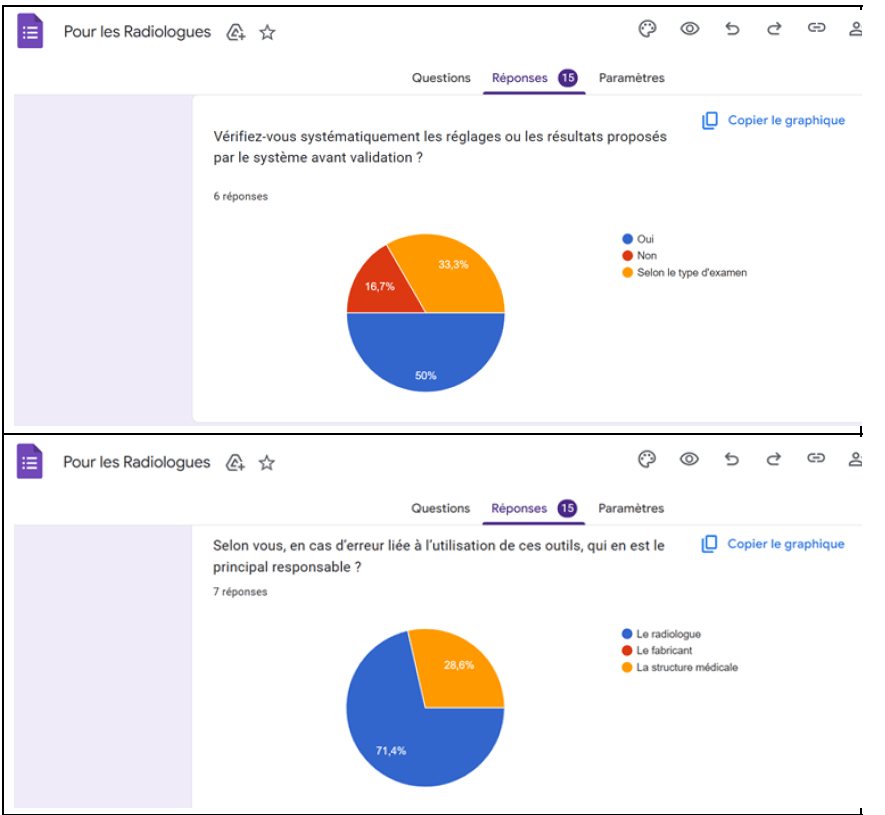

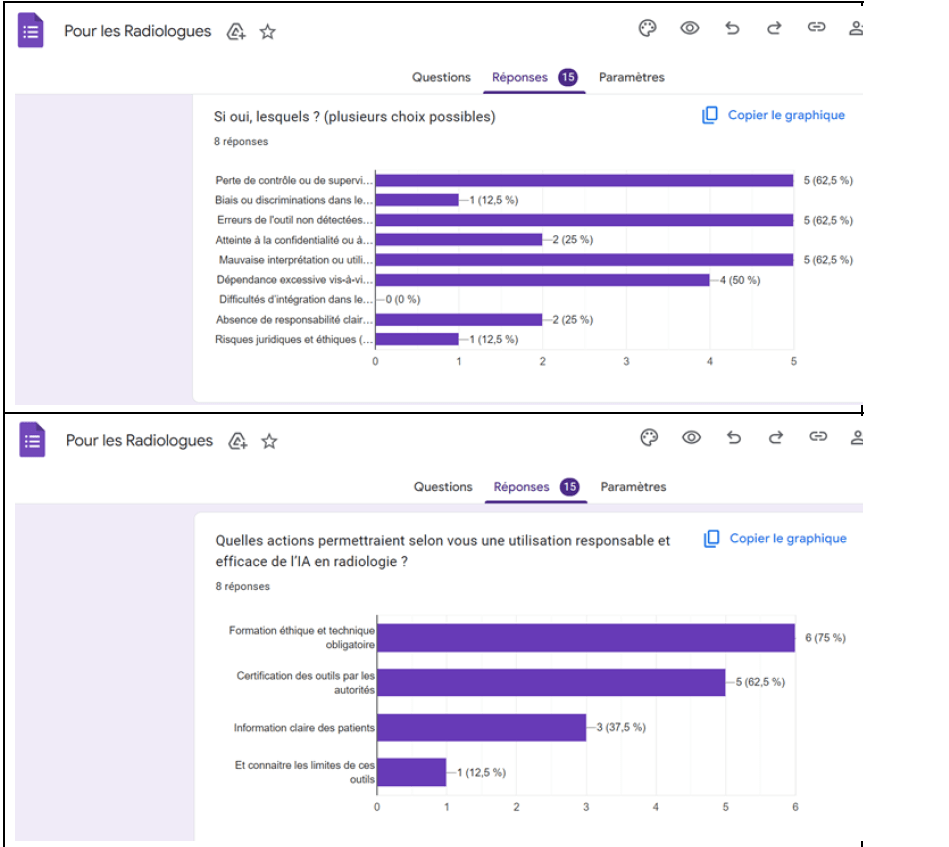

Nous avons recueilli 17 réponses de radiologues, constituant l’échantillon analysé dans cette partie. Des extraits de ces retours sont disponibles en Annexe 1. Les résultats mettent en évidence à la fois une intégration croissante de l’IA dans la pratique quotidienne et plusieurs fragilités en termes de transparence, de formation et de gouvernance.

2.2.5.1 Adoption et usages de l’IA en radiologie

Les résultats montrent que l’IA est déjà largement intégrée dans la pratique radiologique. En effet, 57,1 % des radiologues répondants déclarent utiliser des outils intégrant explicitement l’IA, tandis que 42,9 % estiment ne pas en utiliser. Cette perception doit toutefois être nuancée, puisque 66,7 % des radiologues se déclarant non-utilisateurs disposent en réalité d’équipements proposant des réglages automatiques reposant sur des algorithmes d’IA.

Cette situation met en évidence une utilisation parfois inconsciente de l’IA, liée à l’intégration progressive de fonctionnalités automatisées directement au sein des équipements d’imagerie (IRM, scanner, radiographie). Elle soulève un premier enjeu éthique majeur : le manque de transparence quant à la présence et au rôle de l’IA dans les outils utilisés, ce qui peut limiter la compréhension des systèmes et fragiliser la supervision humaine.

2.2.5.2 Influence de l’IA sur l’image et la décision médicale

Au-delà de son adoption, l’impact de l’IA sur le contenu des images et la prise de décision apparaît significatif. Ainsi, 50 % des radiologues répondants déclarent avoir déjà observé qu’un traitement automatique pouvait modifier fortement une image ou masquer certains détails, tandis que 33,3 % indiquent que cela se produit parfois.

Par ailleurs, l’IA influence directement l’interprétation diagnostique : 60 % des radiologues estiment que les outils d’IA influencent parfois leur interprétation, et 16,7 % déclarent qu’ils l’influencent toujours. Ces résultats montrent que l’IA ne se limite pas à un rôle d’assistance technique, mais qu’elle intervient de manière tangible dans le processus décisionnel médical.

Cette influence renforce la nécessité d’un cadre rigoureux de supervision humaine, conformément aux recommandations éthiques et réglementaires qui classent les systèmes d’IA utilisés en radiologie parmi les dispositifs à haut risque.

2.2.5.3 Supervision humaine et responsabilité

La majorité des radiologues déclarent exercer une supervision sur les résultats produits par l’IA : 85,7 % indiquent vérifier systématiquement les résultats, tandis que 14,3 % déclarent ne procéder qu’à une vérification partielle. Cette vérification partielle correspond généralement à une relecture non systématique des résultats générés par l’IA, limitée à certains cas jugés complexes, atypiques ou à risque, sans contrôle exhaustif de l’ensemble des examens. Bien que cette vigilance soit globalement présente, l’absence de vérification systématique chez certains professionnels constitue un point de fragilité éthique, au regard des exigences de contrôle humain imposées par l’AI Act.

En cas d’erreur liée à l’utilisation d’un outil d’IA, la responsabilité est perçue comme reposant principalement sur le radiologue : 66,7 % des répondants estiment être les principaux responsables, contre 16,7 % pour la structure médicale et 16,7 % pour une responsabilité partagée. Cette perception soulève une difficulté majeure dans un contexte où les professionnels disposent d’un accès limité aux informations sur le fonctionnement et les limites des outils d’IA qu’ils utilisent.

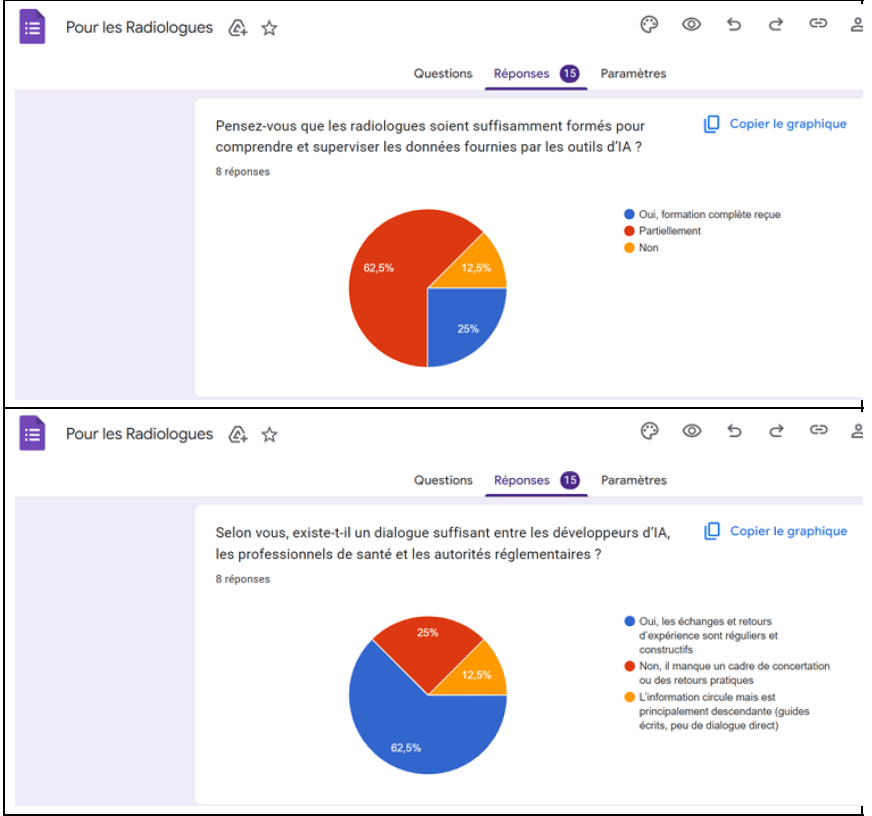

2.2.5.4 Transparence, formation et dialogue

Le manque de transparence apparaît comme l’un des constats les plus marquants de l’enquête. En effet, 87,5 % des radiologues estiment que le fonctionnement des outils d’IA n’est pas clairement expliqué, et 83,3 % expriment le besoin que les fabricants fournissent davantage d’informations sur les principes, les limites et les risques associés aux systèmes.

Parallèlement, l’enquête met en évidence une insuffisance notable de formation : 57,1 % des radiologues déclarent ne pas avoir reçu de formation spécifique à l’IA, tandis que 28,6 % n’ont bénéficié que d’une formation partielle. Cette situation accentue le décalage entre l’usage croissant des outils d’IA et la capacité des professionnels à en assurer une supervision éclairée.

Enfin, 57,1 % des répondants jugent insuffisant le dialogue entre les développeurs d’IA, les autorités et les professionnels de santé, soulignant l’absence d’un cadre structuré de concertation et de retour d’expérience, pourtant essentiel pour une intégration éthique et sécurisée de l’IA en radiologie.

2.2.6 Analyse des réponses fournies par les patients

Nous avons recueilli 63 réponses de patients, constituant l’échantillon analysé dans cette partie. Des extraits de ces retours sont disponibles en Annexe 2. Les résultats obtenus contribuent à évaluer leur niveau d’information, leur confiance, leur acceptabilité de ces technologies ainsi que leurs attentes.

2.2.6.1 Profil et expérience des patients répondants

Les résultats montrent que la population répondante est majoritairement jeune, avec 66,6 % des répondants âgés de moins de 25 ans. Cette répartition ne reflète guère la population générale des patients en imagerie médicale, mais correspond à la population répondante de l’enquête.

Toutefois, 56,3 % des patients répondants déclarent avoir déjà passé plusieurs examens d’imagerie médicale, ce qui indique une expérience concrète du parcours de soins en radiologie. Les perceptions recueillies reposent ainsi sur des situations vécues, renforçant la pertinence des réponses obtenues quant aux pratiques et à l’organisation des examens d’imagerie.

La surreprésentation des patients âgés de moins de 25 ans s’explique principalement par les modalités de diffusion du questionnaire, qui a été réalisé en ligne et relayé via des réseaux numériques. Ce mode de collecte favorise naturellement la participation de populations plus jeunes, généralement plus familières avec les outils numériques et plus enclines à répondre à ce type d’enquête.

Ce déséquilibre constitue une limite méthodologique de l’étude, dans la mesure où il peut influencer les résultats relatifs à l’acceptabilité et à la perception de l’IA. Les patients plus jeunes tendent en effet à présenter une plus grande familiarité avec les technologies innovantes. Les résultats doivent donc être interprétés avec prudence et ne peuvent être considérés comme pleinement représentatifs de l’ensemble des patients en imagerie médicale, notamment des populations plus âgées ou moins connectées numériquement.

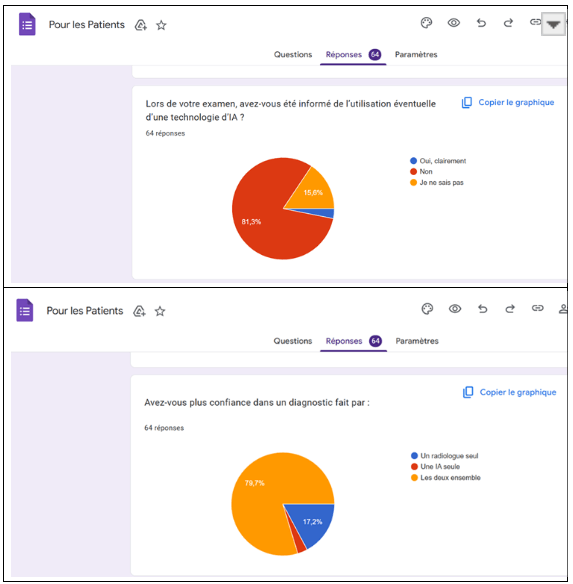

2.2.6.2 Information et transparence perçues

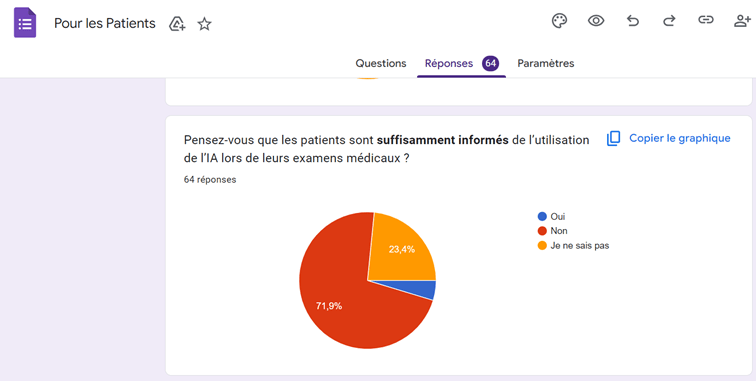

En matière d’information, les résultats mettent en évidence un décalage entre la connaissance générale de l’IA et l’information effectivement reçue par les patients. En effet, 62,5 % des répondants déclarent savoir que l’IA peut être utilisée en imagerie médicale, traduisant une certaine sensibilisation aux usages numériques en santé.

Cependant, cette connaissance reste majoritairement théorique, puisque 81,3 % des patients déclarent ne pas avoir été informés de l’utilisation éventuelle de l’IA lors de leurs propres examens. Ce résultat doit toutefois être nuancé, dans la mesure où une partie des patients peut avoir été informée de manière indirecte ou implicite, sans identifier clairement l’usage de l'IA comme tel, notamment lorsque celle-ci est intégrée de façon transparente aux équipements ou aux logiciels d’imagerie.

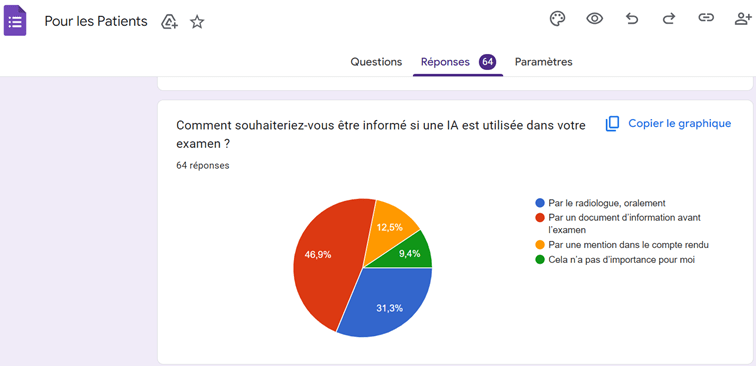

Ce constat met néanmoins en évidence une insuffisance de transparence explicite vis-à-vis des patients, en particulier concernant le rôle réel de l’IA dans le processus d’examen et d’interprétation. Cette situation apparaît en décalage avec les principes du consentement éclairé et les recommandations éthiques et réglementaires actuelles, qui insistent sur la nécessité d’une information compréhensible et accessible pour les patients.

2.2.6.3 Acceptabilité et bénéfices perçus

Malgré le manque d’information explicite rapporté précédemment, l’IA bénéficie d’une perception globalement positive auprès des patients. Ainsi, 68,8 % des répondants déclarent percevoir l’IA de manière favorable, l’associant principalement à une amélioration de la qualité des soins.

Les principaux bénéfices attendus concernent :

- une plus grande rapidité dans l’obtention des résultats,

- une amélioration de la précision diagnostique,

- une réduction du risque d’erreur.

Ces résultats traduisent une perception de l’IA comme un outil de soutien au processus médical, venant compléter l’action du professionnel de santé. Cette interprétation repose sur les tendances observées dans les réponses quantitatives et non sur des verbatims explicites, et doit donc être comprise comme une lecture globale des attentes exprimées par les patients, plutôt que comme une affirmation formulée directement par ces derniers.

2.2.6.4 Risques et limites perçus

Les patients expriment néanmoins des inquiétudes significatives, principalement liées aux enjeux éthiques. Les risques les plus fréquemment exprimés sont :

- les erreurs liées à la machine et au logiciel d’analyse des images (67,2 %),

- la perte du contact humain dans la relation de soin (58,3 %),

- les risques concernant la protection des données personnelles (45,3 %).

Ces préoccupations témoignent d’une conscience claire des limites potentielles de l’IA et rejoignent les débats éthiques actuels autour de la sécurité, de la confidentialité et de la place de l’humain dans les soins.

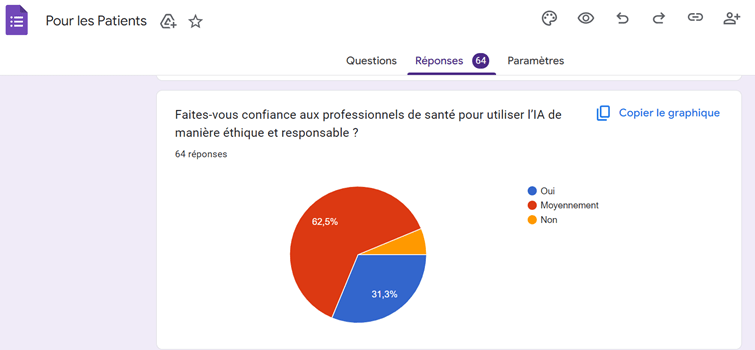

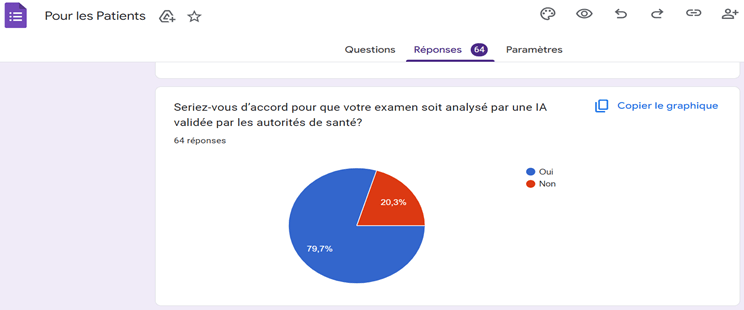

2.3.6.5 Confiance, responsabilité et consentement

La confiance accordée à l’IA dépend fortement de la présence d’un professionnel de santé. Une large majorité des patients (82,8 %) exprime une faible ou inexistante confiance envers un diagnostic reposant uniquement sur l’IA. À l’inverse, 78,7 % déclarent avoir davantage confiance dans une décision conjointe associant l’IA et le radiologue, confirmant la nécessité d’un modèle de collaboration homme–machine. Concernant le consentement, 48,9 % des patients estiment qu’un accord explicite devrait être demandé avant l’utilisation de l’IA, soulignant l’importance accordée au respect de l’autonomie et au droit à l’information

2.2.7 Enseignements tirés des entretiens semi-directifs

Les entretiens menés auprès d'ingénieurs d’application d'entreprises commercialisant des solutions d'IA pour la radiologie ont permis d’apporter un éclairage qualitatif complémentaire aux résultats issus des questionnaires. Contrairement aux données quantitatives, ces entretiens ne visent pas à produire des indicateurs chiffrés, mais à analyser des tendances récurrentes, des perceptions partagées et des situations concrètes rapportées par les professionnels interrogés.

Ils permettent ainsi d’identifier plusieurs freins à l’intégration de l’IA en radiologie, relevant principalement de dimensions organisationnelles, professionnelles et symboliques, plutôt que de limites techniques strictes.

2.2.7.1 Réticences de certains radiologues face à l’IA pour l’aide au diagnostic

Les ingénieurs d’application rapportent que certains radiologues expriment des réticences vis-à-vis de l’intégration de l’IA, en particulier lorsqu’elle est présentée comme une aide au diagnostic. Ces réticences ne sont pas systématiquement liées aux performances techniques des outils, mais davantage à des représentations professionnelles de l’acte médical.

Le qualificatif de frein culturel renvoie ici à la perception du rôle du radiologue, à son identité professionnelle et à la place qu’il occupe dans la décision médicale. Certains radiologues associent l’IA à une remise en question de leur expertise ou de leur légitimité clinique, ce qui peut générer des résistances indépendamment de l’efficacité réelle des systèmes. Ce type de frein relève donc moins de la technologie elle-même que de son impact symbolique sur les pratiques et les responsabilités professionnelles.

2.2.7.2 Formation des radiologues : une approche clinique pertinente mais incomplète

Les ingénieurs indiquent que la formation proposée aux radiologues est majoritairement centrée sur l’usage clinique des outils d’IA, notamment leur rôle d’aide à l’interprétation et de second lecteur. Cette approche favorise une appropriation rapide des outils dans la pratique quotidienne.

Cependant, les entretiens mettent en évidence une attente plus large de la part de certains radiologues, qui souhaitent mieux comprendre les principes généraux de fonctionnement des algorithmes, leurs conditions d’entraînement, leurs limites et leurs risques. Cette demande traduit un besoin de maîtrise suffisant pour pouvoir exercer une supervision humaine éclairée, condition essentielle à un usage éthique et responsable de l’IA.

2.2.7.3 Place de l’IA dans la décision médicale : une position consensuelle

Les entretiens révèlent un consensus clair concernant la place de l’IA dans la décision médicale. L’IA est perçue comme un outil d’assistance, destiné à soutenir le radiologue dans son analyse, sans jamais se substituer à son jugement clinique.

Cette position synthétise les éléments évoqués précédemment : le radiologue demeure l’acteur central de l’interprétation et de la validation finale du diagnostic, conformément aux principes de supervision humaine et de responsabilité médicale. L’IA est ainsi intégrée comme un appui technique, et non comme un décideur autonome.

2.2.7.4 Responsabilité médicale et vérification des résultats

Les ingénieurs d'application interrogés rappellent que la responsabilité médicale incombe toujours au radiologue, l’IA étant considérée juridiquement comme un outil d’aide à la décision. Cette responsabilité implique une vérification systématique des résultats produits par les algorithmes, afin de limiter les risques d’erreur, de faux positifs ou de faux négatifs.

Les entretiens soulignent également le risque d’une confiance excessive accordée aux outils automatisés. L’usage éthique de l’IA repose donc sur un équilibre entre assistance technologique et maintien d’un regard critique du professionnel.

2.2.7.5 Information des patients et relation de confiance

Concernant l’information des patients, les ingénieurs d'application interrogés rapportent des pratiques hétérogènes. Certaines initiatives locales existent, telles que l’affichage de supports explicatifs ou des échanges ponctuels avec les patients, mais elles restent non systématisées.

Les réticences à informer explicitement les patients reposent principalement sur la crainte que l’IA soit mal comprise, génère de l’anxiété ou altère la relation de confiance. Cette prudence révèle une tension entre le principe de transparence et la volonté de préserver une relation de soin apaisée.

Toutefois, cette approche peut être questionnée. L’absence ou l’insuffisance d’information risque, à terme, d’affaiblir la confiance des patients si l’usage de l’IA est découvert a posteriori. Les entretiens suggèrent ainsi que la relation de confiance ne dépend pas tant de la présence de l’IA que de la qualité de l’explication fournie, de sa clarté et de son adaptation au niveau de compréhension du patient. Une information progressive et contextualisée apparaît comme une condition essentielle pour concilier transparence, acceptabilité et confiance.

2.2.8 Analyse croisée des données issues des questionnaires et des entretiens semi-directifs

L’analyse croisée des questionnaires adressés aux radiologues et aux patients, complétée par les entretiens menés auprès des ingénieurs d’application, permet de confronter trois points de vue complémentaires sur l’intégration de l’IA en radiologie. Cette approche met en évidence à la fois des convergences fortes dans les représentations et les attentes, ainsi que des divergences révélatrices d’enjeux éthiques persistants.

2.2.8.1 Convergences majeures

Une convergence essentielle concerne la place de l’IA dans la décision médicale. Les trois catégories d’acteurs s’accordent sur le fait que l’IA ne doit pas être autonome, mais intégrée comme un outil d’aide à la décision. Les radiologues revendiquent une validation humaine systématique, les patients expriment une confiance accrue lorsque l’IA est utilisée conjointement avec le radiologue, et les ingénieurs d'application conçoivent l’IA comme un second lecteur. Ce consensus traduit l’importance accordée au principe de supervision humaine.

Un second point de convergence porte sur le besoin de transparence. Radiologues et patients soulignent un manque d’information et d’explicabilité des outils d’IA, tandis que les ingénieurs d'application reconnaissent les difficultés techniques et pédagogiques associées à ces enjeux. Cette convergence met en évidence une attente partagée de compréhension du rôle, des limites et de l’impact de l’IA dans le parcours de soins.

Enfin, la sécurité et la fiabilité des systèmes d’IA constituent une préoccupation transversale. Les risques d’erreurs, de biais et d’atteinte aux données personnelles sont identifiés par l’ensemble des acteurs, confirmant l’alignement global des perceptions avec les principes éthiques et réglementaires existants.

2.2.8.2 Divergences et angles morts

Malgré ces convergences, plusieurs divergences apparaissent. Du côté des radiologues, l’analyse révèle une utilisation parfois peu consciente de certaines fonctionnalités intégrant de l’IA, liée à leur intégration progressive dans les équipements d’imagerie. Cette situation est confirmée par les ingénieurs d'application et peut limiter l’exercice d’une supervision pleinement éclairée.

Du côté des patients, l’angle mort principal concerne l’information. Une majorité déclare ne pas avoir été informée de l’usage de l’IA lors de ses examens, tandis que certains radiologues hésitent à communiquer explicitement sur ce sujet. Cette situation crée une asymétrie informationnelle susceptible d’affecter la confiance et le consentement.

La responsabilité constitue également un point de tension. Les radiologues se sentent majoritairement responsables en cas d’erreur liée à l’IA, alors que les patients privilégient une responsabilité plus partagée. Les ingénieurs d'application rappellent que, sur le plan juridique, la responsabilité finale demeure celle du radiologue, malgré une maîtrise parfois limitée des systèmes utilisés.

2.2.8.3 Implications éthiques

Ces constats soulignent plusieurs implications éthiques majeures. Le déficit d’information des patients remet en question le respect du principe d’autonomie et du consentement éclairé. Par ailleurs, l’opacité partielle des outils d’IA place les radiologues dans une situation délicate, où une responsabilité élevée coexiste avec une capacité de maîtrise limitée, en tension avec le principe de responsabilité proportionnée.

Enfin, l’analyse met en évidence l’importance d’un dialogue renforcé entre les différents acteurs professionnels de santé, industriels, institutions et patients comme condition essentielle à une intégration éthique, transparente et durable de l’IA en radiologie.

Chapitre 3 - Recommandations pour une intégration éthique de l’intelligence artificielle en radiologie

À l’issue de l’analyse des cadres réglementaires et éthiques existants, de l’identification de leurs limites et de leur confrontation aux résultats de l’étude de terrain, un ensemble de recommandations opérationnelles a été élaboré. Ce travail constitue un livrable central du projet, visant à accompagner les différents acteurs de la radiologie dans une intégration concrète, responsable et éthiquement encadrée de l’IA.

Les recommandations proposées ont pour objectif de traduire les principes généraux portés par les référentiels institutionnels et réglementaires en actions applicables au quotidien, en tenant compte des réalités et des contraintes du terrain. Elles reposent sur une approche pragmatique, fondée à la fois sur les exigences normatives et sur les retours d’expérience des professionnels, des patients et des acteurs industriels interrogés.

Plusieurs volets complémentaires, identifiés comme prioritaires tant par les textes de référence que par l’enquête de terrain, structurent ces recommandations. Ils concernent notamment la transparence et l’information des patients, la clarification du rôle de l’IA et des responsabilités associées, la formation et la montée en compétences des professionnels, la supervision humaine et la traçabilité des usages, ainsi que la gouvernance et le suivi post-déploiement des outils d’IA.

L’objectif de cette démarche n’est pas de proposer un cadre supplémentaire, mais de faciliter l’appropriation des exigences existantes en les adaptant aux pratiques réelles de la radiologie. Ces recommandations s’inscrivent ainsi dans une logique de construction entre professionnels de santé, industriels, institutions et patients, afin de renforcer la confiance, la sécurité et l’acceptabilité de l’IA en radiologie.

3.1. Recommandations à destination des radiologues

Utiliser l’IA exclusivement comme outil d’aide au diagnostic, avec validation humaine systématique : l’enquête montre que l’IA influence déjà l’interprétation diagnostique. Il est donc essentiel de rappeler que l’IA ne doit jamais être utilisée comme un décideur autonome. La validation humaine systématique garantit la sécurité des soins et s’inscrit pleinement dans les exigences éthiques et réglementaires applicables aux systèmes d’IA à haut risque.

Vérifier de manière critique les résultats générés par l’IA : les outils d’IA peuvent produire des erreurs, des faux positifs ou des faux négatifs. Une vérification critique permet de limiter le risque d’automatisation excessive et de maintenir un regard clinique actif. Cette vigilance est d’autant plus nécessaire que le fonctionnement interne des algorithmes reste souvent partiellement opaque.

Informer les patients lorsque cela est pertinent : les résultats montrent un déficit important d’information des patients. Une information claire, adaptée au niveau de compréhension du patient, contribue à renforcer la confiance et le respect de l’autonomie, sans nécessairement générer d’anxiété lorsqu’elle est bien expliquée.

Participer activement aux formations liées à l’IA : le manque de formation identifié constitue un frein majeur à une supervision éclairée. Les radiologues doivent pouvoir comprendre non seulement l’usage clinique des outils, mais aussi leurs limites, leurs biais potentiels et les enjeux éthiques associés.

Contribuer aux retours d’expérience et à l’amélioration continue : le signalement des erreurs, des limites ou des situations à risque permet d’améliorer la qualité et la sécurité des outils. Cette démarche collective est essentielle pour faire évoluer les systèmes d’IA de manière responsable.

3.2. Recommandations à destination des professionnels en établissements de santé

Mettre en place une gouvernance locale dédiée à l’IA : une gouvernance structurée permet de définir des responsabilités claires, d’encadrer les usages et d’assurer la conformité réglementaire. Elle favorise également la coordination entre professionnels de santé, ingénieurs et responsables qualité.

Définir des règles claires d’usage, de supervision et de traçabilité : des règles formalisées permettent d’éviter des usages non maîtrisés de l’IA et de garantir une supervision humaine effective. La traçabilité est essentielle en cas d’incident ou de question médico-légale.

Garantir la conformité réglementaire et la protection des données

Les établissements ont la responsabilité de s’assurer que les outils utilisés respectent les exigences réglementaires, notamment en matière de protection des données personnelles et de sécurité des systèmes.

Organiser le suivi post-déploiement et le traitement des incidents : l’IA ne peut être considérée comme fiable de manière définitive. Un suivi continu permet d’identifier les dérives, les erreurs et les évolutions nécessaires des outils après leur mise en service.

Soutenir la formation et l’accompagnement des professionnels : un accompagnement institutionnel renforce l’appropriation des outils et réduit les risques liés à une utilisation inadaptée ou mal comprise.

3.3. Recommandations à destination des éditeurs de solutions logicielles exploitant l'intelligence artificielle

Fournir des outils conformes aux exigences réglementaires : les industriels doivent intégrer dès la conception les exigences réglementaires applicables aux logiciels DM à haut risque, afin de garantir la sécurité et la fiabilité des solutions proposées.

Documenter clairement les performances, limites et conditions d’utilisation : une documentation claire permet aux radiologues de comprendre dans quels contextes l’outil est pertinent, mais aussi dans quelles situations ses performances peuvent être dégradées.

Assurer une explicabilité compréhensible pour les radiologues : l’explicabilité ne doit pas être uniquement technique. Elle doit être adaptée aux besoins des radiologues, afin de leur permettre d’interpréter les résultats de l’IA et d’exercer une supervision effective.

Intégrer la supervision humaine dès la conception : la supervision humaine ne doit pas être ajoutée a posteriori. Elle doit être pensée comme un élément central du fonctionnement des outils d’IA.

Participer à un dialogue continu avec les utilisateurs et les institutions : un échange régulier permet d’adapter les outils aux besoins réels du terrain et d’anticiper les enjeux éthiques et organisationnels.

3.4. Recommandations à destination des institutions et autorités

Clarifier les cadres réglementaires et leurs modalités d’application : les acteurs de terrain expriment un besoin de lisibilité des textes réglementaires. Une clarification facilite leur appropriation et leur mise en œuvre concrète.

Favoriser la coordination entre les acteurs du système de santé : une coordination renforcée permet d’éviter les incohérences entre exigences réglementaires, pratiques professionnelles et solutions industrielles.

Encourager la formation et l’acculturation à l’IA en santé : la formation constitue un levier essentiel pour une intégration éthique et sécurisée de l’IA.

Suivre et évaluer les usages réels des outils d’IA : l’évaluation continue des usages permet d’identifier les dérives potentielles et d’adapter les cadres existants.

Garantir la protection des droits des patients : les autorités doivent veiller au respect effectif des droits des patients, notamment en matière d’information, de consentement et de protection des données.

3.5. Recommandations à destination des patients et usagers

Être informés de manière claire et accessible : une information compréhensible permet aux patients de mieux accepter l’usage de l’IA et de renforcer leur confiance dans le système de soins.

Conserver un rôle actif dans la relation de soin : l’IA ne doit pas affaiblir la relation médecin/patient, mais la soutenir. Le patient doit rester un acteur des décisions qui le concernent.

Être associés aux démarches d’acceptabilité et d’amélioration des pratiques : l’implication des patients permet d’adapter les usages de l’IA à leurs attentes et à leurs préoccupations éthiques.

3.6. Proposition d’un outil pratique pour une intégration éthique opérationnelle de l’IA en radiologie

Afin de faciliter leur appropriation, ces recommandations ont été synthétisées et regroupées au sein d’un livret dédié, conçu comme un outil pratique et accessible. Ce livret constitue un récapitulatif structuré des principaux enseignements du travail et vise à accompagner les acteurs de la radiologie dans la mise en œuvre opérationnelle des exigences éthiques et réglementaires liées à l’IA.

Il ne s’agit pas d’un cadre supplémentaire, mais d’un support d’aide à la décision et à la pratique, favorisant une compréhension partagée des responsabilités, des bonnes pratiques et des conditions nécessaires à une utilisation responsable de l’IA en radiologie.

Le livret de recommandations est disponible depuis la section "Téléchargements" du sommaire, accessible en haut de la présente page.

Conclusion

L’IA constitue une avancée majeure pour la radiologie, en contribuant à l’amélioration de la qualité et de l’efficacité du diagnostic. Toutefois, son intégration ne peut être envisagée uniquement sous l’angle de la performance technologique. Elle soulève des enjeux éthiques et réglementaires étroitement liés, reconnus au niveau international [15].

L’état de l’art a montré que les principes éthiques fondamentaux (supervision humaine, transparence, responsabilité et protection des droits des patients) sont aujourd’hui intégrés aux cadres réglementaires existants, en particulier au niveau européen. L’analyse s’est principalement appuyée sur l'AI Act, complété par des guides institutionnels et professionnels à portée nationale et internationale, confirmant que les systèmes d’IA utilisés en radiologie relèvent de la catégorie des systèmes à haut risque et nécessitent des garanties renforcées [5,18].

La confrontation de ces cadres avec les résultats de l’étude de terrain met en évidence une acceptabilité globale de l’IA, tant chez les radiologues que chez les patients, à condition de maintenir une supervision humaine systématique et de considérer l’IA comme un outil d’aide au diagnostic, sous validation du radiologue, conformément aux recommandations de la Société Européenne de Radiologie [21]. Néanmoins, des écarts persistent entre les principes formalisés et leur application concrète, notamment en matière d’information des patients et de formation des professionnels, en contradiction avec les exigences du RGPD et les recommandations de la CNIL [22].

Face à ces constats, des recommandations opérationnelles ont été proposées afin de faciliter l’appropriation des exigences existantes et de répondre aux besoins exprimés sur le terrain. En conclusion, le principal enjeu de l’IA en radiologie réside moins dans la performance des algorithmes que dans leur intégration éthique et opérationnelle, condition essentielle pour préserver la confiance des patients et renforcer le rôle central du radiologue dans la décision médicale.

Références bibliographiques

[1] A. Esteva et al., « A guide to deep learning in healthcare », Nat. Med., janv. 2019, Consulté le : 14 octobre 2025. [En ligne]. Disponible sur : https://www.nature.com/articles/s41591-018-0316-z

[2] S. Parekh, « AI in Medical Imaging Market to Reach $1.5B by 2024 », Signify Res., sept. 2020, [En ligne]. Disponible sur : https://www.signifyresearch.net/2020/09/10/ai-medical-imaging-market-reach-1-5b-2024/

[3] H. Hamma et al., « Processus et impacts territoriaux de l’ingénierie biomédicale en France : usage et apports de la cartographie ANAP-AFIB », IRBM News, vol. 44, no 3, p. 100470, juin 2023, https://doi.org/10.1016/j.irbmnw.2023.100470

[4] V. Nurock et F. Berger, « Quelle éthique pour les nouvelles technologies ? : épisode 2/3 du podcast La science et ses mauvaises consciences », France Culture, 24 juin 2025. [En ligne]. Disponible sur : https://www.radiofrance.fr/franceculture/podcasts/avec-philosophie/quelle-ethique-pour-les-nouvelles-technologies-9079324

[5] Journal officiel de l’Union européenne, « Règlement (UE) 2024/1689 du Parlement européen et du Conseil du 13 juin 2024 établissant des règles harmonisées concernant l’intelligence artificielle et modifiant les règlements (CE) n° 300/2008, (UE) n° 167/2013, (UE) n° 168/2013, (UE) 2018/858, (UE) 2018/1139 et (UE) 2019/2144 et les directives 2014/90/UE, (UE) 2016/797 et (UE) 2020/1828 (règlement sur l’intelligence artificielle) (Texte présentant de l’intérêt pour l’EEE) », juin 2024. [En ligne]. Disponible sur : https://eur-lex.europa.eu/eli/reg/2024/1689/oj/fra

[6] E. Alipour et al., « Current Status and Future of Artificial Intelligence in MM Imaging : A Systematic Review », Diagn. Basel Switz., nov. 2023, [En ligne]. Disponible sur : https://doi.org/10.3390/diagnostics13213372

[7] I. Goodfellow et al., "Deep learning", Cambridge, Massachusetts : The MIT Press, 2016. [En ligne]. Disponible sur : https://archive.org/details/deeplearning0000good

[8] Y. LeCun, et al., « Deep learning », Nature, vol. 521, no 7553, p. 436‑444, mai 2015, https://doi.org/10.1038/nature14539

[9] L. Machado et al., « La radiologie entre deux vagues : Adoption de l’intelligence artificielle dans les hôpitaux universitaires français en 2025 », J. Imag. Diagn. Interv., déc. 2025, disponible sur : https://doi.org/10.1016/j.jidi.2025.07.003

[10] I. Bloch, « Intelligence artificielle et diagnostic médical, quels enjeux éthiques ? Limites et fantasmes, le point de vue du chercheur », J. Imag. Diagn. Interv., févr. 2025, https://doi.org/10.1016/j.jidi.2024.09.004

[11] Medtech France, « IA en santé : qui porte la responsabilité en cas d’erreur ? », Medtech Fr., juin 2025, [En ligne]. Disponible sur : https://www.medtechfrance.fr/reglementation-et-economie/cadre-legislatif-et-normes/entre-serment-dhippocrate-et-code-source-la-deontologie-medicale-a-lepreuve-de-lintelligence-artificielle/

[12] Gouvernement (France), « Stratégie intelligence artificielle et données de santé - 2025-2028 », juil. 2025, [En ligne]. Disponible sur : https://sante.gouv.fr/IMG/pdf/strategie_donnees_et_intelligence_artificielle.pdf